|

Du 28 mars au 1er avril dernier avait lieu Laval Virtual 2012, la 14e édition de cette conférence internationale sur la réalité virtuelle et les technologies convergentes. |

Nous vous proposons aujourd’hui un compte-rendu du salon, sous ses différents aspects : stands d’entreprises, projets de recherche ou encore conférences et keynotes. |

Vue panoramique de Laval.

|

Laval Virtual en bref Laval Virtual est un salon qui a su trouver son rythme de croisière, 13 000 visiteurs environ, dont 4400 professionnels de tous horizons : industrie, services, recherche, enseignement ou encore architecture. Pour cette édition, 84 entreprises exposantes avaient fait le déplacement, dont 16 % venues de l’étranger. |

Saluons au passage la transparence des organisateurs, qui ont mis en ligne de nombreux chiffres sur les origines des visiteurs ou exposants. Installé au coeur de la Mayenne, Laval Virtual offre un cadre qui change radicalement des éternels salons parisiens ; les visiteurs étrangers semblaient d’ailleurs bien apprécier la vieille ville. |

Ci-dessous, vue globale du salon, aperçu de l’espace détente au centre du hall, et plan général : l’ensembleétait efficacement agencé, et la circulation dans les allées n’a pas posé le moindre problème.

Crédit photo pour la vue d’ensemble : Laval Virtual 2012 – J.-C. Druais

Vieille ville, centre de conférence : un cadre qui a du charme !

|

Entreprises, centres de recherche Passons maintenant aux stands présents sur le salon : entreprises, groupes de recherche, revendeurs de solutions ou encore écoles étaient présents, dans des domaines très variés. Laval Virtual ne se limite clairement plus à la réalité virtuelle, même si cette thématique reste le coeur historique de la manifestation. I’m In VR : réalité virtuelle sous Unity I’m In VR est une start-up lancée par Sébastien Kuntz, ingénieur qui a plus de 10 ans d’expérience dans le secteur de la réalité virtuelle, en particulier au sein de Dassault Systèmes et sur Virtools. Digiteyezer : le Photomaton du scan 3D DigitEyezer, start-up française spécialisée dans la photogrammétrie (scan 3D à partir de photos), a déjà été évoquée sur 3DVF pour ses produits iFace3D et iScan3D, deux applications iPhone permettant respectivement de scanner des visages et des objets en tous genres. La société a profité du salon pour annoncer son nouveau produit, Easy Twin. Il s’agit en fait d’une extension de leur système de scan de visage, créé suite à la demande de clients qui voulaient une solution plus simple et rapide pour obtenir un modèle de visage. |

Le principe rappelle celui du photomaton : l’utilisateur place sa tête devant le système, reste statique durant une seconde le temps de la prise de vue : une série de petits objectifs vont en fait prendre des clichés simultanés à 180°, sous un éclairage contrôlé et uniforme (ce qui explique la forme de l’engin). Une minute plus tard un modèle 3D du visage est disponible sous trois formes : nuage de points, scan « réaliste » (le scan brut), et enfin une version « avatar » : le modèle 3D aura alors des formes adoucies pour compenser les éventuels artefacts créés lors de la reconstruction, une peau unifiée, mais aussi et surtout disposera d’une topologie et d’un rig qui permettront de facilement l’animer. La version en démonstration sur le stand le démontrait d’ailleurs sur tablette : une application iPad permettait d’appliquer sur le modèle, outre des accessoires divers et variés, des animations et expressions prédéfinies. Easy Twin, de même que les applications iPhone de la société, restent cependant et en premier lieu une vitrine technologique pour DigitEyezer : clairement, ce ne sont par exemple pas les 45 000 téléchargements de iFace3D (vendu 0,79 €) qui feront vivre la société. Le but est surtout d’assurer à DigitEyezer une certaine notoriété, attirant des clients qui auront des demandes spécifiques. Easy Twin est d’ailleurs justement issu d’une telle demande. |

Ci-dessous, présentation vidéo de MiddleVR for Unity.

Ci-dessous, aperçu en images et vidéo de l’application sur iPad qui permettait de visualiser et modifier le résultat du scan sous Easy Twin : nuage de point et reconstitution brute avec expression neutre, version « avatar » (avec lissage du modèle, et utilisation d’une topologie adaptée à l’animation). Il est ensuite possible d’ajouter coiffures et accessoires, mais aussi d’appliquer des émotions ou de caricaturer le visage.

|

Robocortex : SDK de tracking et réalité augmentée Dans un tout autre domaine, la société RoboCortex dévoilait ses solutions de tracking et réalité augmentée sans marqueur. Lancée il y a un an et demi, elle propose en fait deux SDK : Nous nous sommes évidemment surtout intéressés à la partie réalité augmentée, plus proche des thématiques de 3DVF. Le système semble très robuste : malgré un éclairage faible, le système arrivait à reconnaître et suivre l’image même en l’inclinant ou en l’éloignant de la caméra. Des performances nettement supérieures à nombre de systèmes concurrents. |

Enfin, un prototype de tracking 3D nous a été dévoilé : exit le suivi d’images planes, c’est ici un objet de forme arbitraire qui est reconnu. En pratique, le SDK a besoin d’avoir en mémoire une représentation de l’objet 3D, qu’il s’agisse d’un modèle CAO ou d’une reconstruction par photogrammétrie. Les applications sont ici très larges, on pense par exemple à de la maintenance industrielle : un iPad placé face à une machine complexe saura la reconnaître et afficher en réalité augmentée des détails sur la maintenance. Nous avons interrogé Robocortex sur d’éventuels plugins basés sur ses SDK pour des applications 3D comme Unity : ce n’est pas au programme, car cela risquerait d’éloigner la société de son coeur de métier (améliorer encore ses SDK). Par contre, une personne souhaitant créer puis revendre un plugin pour Unity ou tout autre système pourra tout à fait s’appuyer sur le SDK Rox Odometry. |

|

Ayotle : motion capture de visage Poursuivons la visite avec Ayotle, une start-up basée à Paris et Mexico. La société présentait plusieurs produits, dont le très intéressant système Facetracker : un logiciel de motion capture faciale sans marqueur, en temps réel et avec une simple webcam. Un matériel simple et au coût négligeable, donc. Les applications : web, broadcast mais aussi jeu vidéo et publicité personnalisés. En pratique, Ayotle propose des services de type consulting, développement ou encore prototypage de solutions utilisant ses technologies. Des prestations sont aussi au menu : Ayotle, à partir d’une vidéo fournie par le client, pourra ainsi fournir en retour les données de motion capture ou l’animation finale. |

MgDesign, Cent Millions de Pixers, MzoneStudio Plus loin, trois sociétés faisaient stand commun : mgDesign, Cent Millions de Pixels et MzoneStudio. Plusieurs projets nous ont été présentés : port à bateau souterrain, application d’urbanisme pour la vente de lots immobiliers, animations 3D pour mettre en avant des machines conçues par Léonard de Vinci ou encore un jeu à la Doodle Jump pour Hénaf. Un moteur 3D maison, développé par mgDesign, fait tourner les applications 3D temps réel. |

Ci-dessous, aperçu de Facetracker, développé par Ayotle.

Ci-dessous, concept Bluering : hangar à bateau souterrain. Une réalisation mgDesign.

Démoreel 2010 de mgDesign ; une grande partie des réalisations a été effectuée en partenariat avec Cent Millions de Pixels.

|

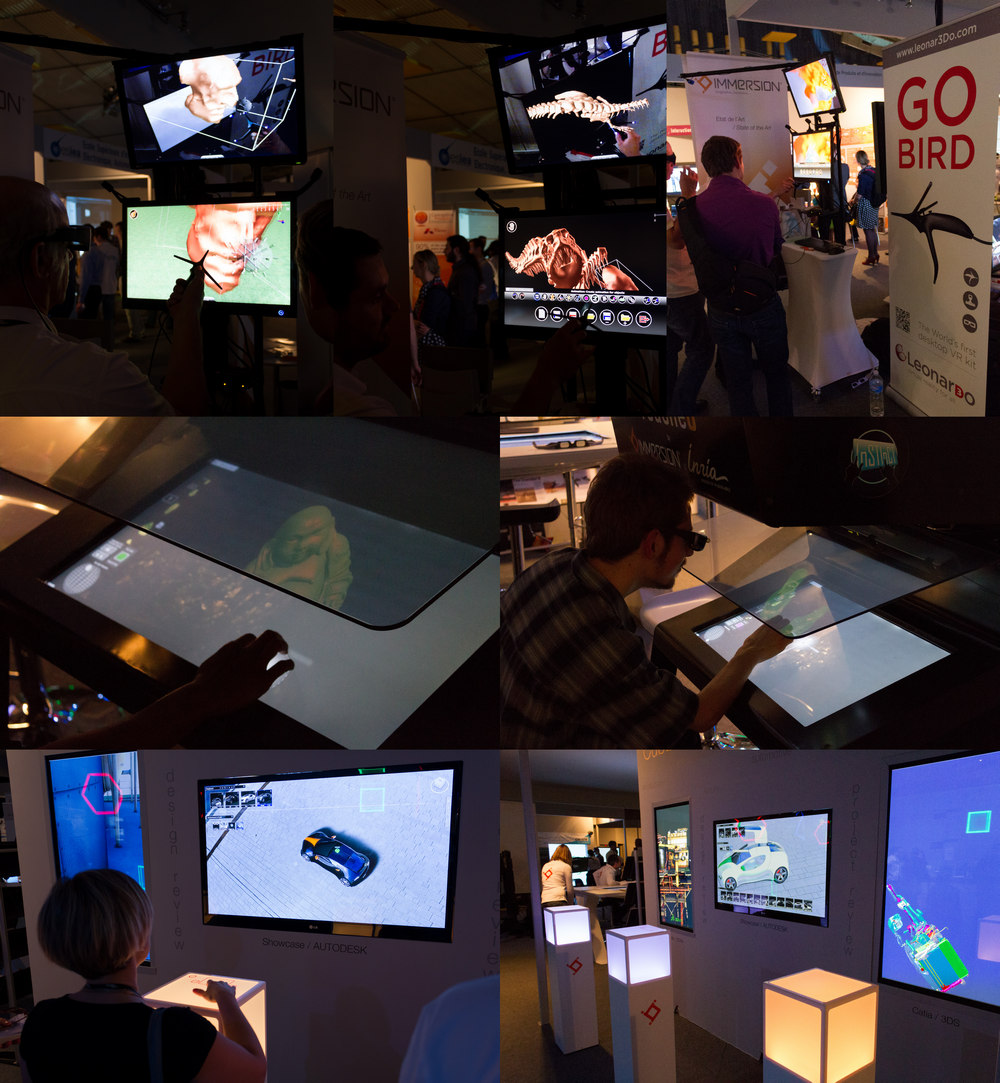

Immersion, incontournable du salon Impossible de parler de Laval Virtual 2012 sans évoquer Immersion, dont le stand imposant proposait des démonstrations de différentes solutions et interfaces innovantes. |

Le but est en fait d’offrir une interface intuitive : l’utilisateur manipule les objets et interagit via l’écran tactile, tandis que la surface semi-réfléchissante permet d’afficher les objets en relief, sans que ceux-ci ne soient masqués par les mains. En quelque sorte, tous les avantages du tactile et du relief combinés, mais en retirant une bonne partie des inconvénients… À l’heure actuelle, la revente ne constitue qu’un tiers du CA d’Immersion : cette activité historique de la société tend donc à s’éclipser devant la création et vente de solutions propres. |

Ci-dessous, stand Immersion : Leonar3Do, outil de manipulation 3D et sculpture avec relief et un outil dédié pour interagir sans toucher l’écran ; le très convainquant Toucheo, avec son système de superposition : l’écran situé en bas, juste sous la main, affiche l’interface de manipulation et sert à la gestion tactile. la vitre située au milieu réfléchit l’image affichée par l’écran situé au-dessus : l’objet 3D est perçu comme étant au-dessus de la main de l’utilisateur, qui n’obstrue pas la vue. Enfin, le Cubtile permet grâce à ses faces et manipuler des démos temps réel.