| Character/Actor Face

Le character face est une interface permettant de gérer l’animation faciale des personnages. Il fonctionne sur la base de Blendshape, que ce soit avec un personnage à base de blendshape ou disposant d’un setup facial de bones/clusters. |

Cela peut s’avérer plus ou moins long selon les besoins de la production. L’actor Face intervient la plupart du temps pour s’interfacer entre le Character face et des données de motion capture faciale. Malheureusement, le character face n’est pas aussi développé que le Character Control. En utilisation, il ne semble pas évoluer avec les versions se succédant de Mobu. Très peu de nouveauté sont à noter sur MotionBuilder 2012 pour les outils d’animation faciale depuis MotionBuilder 7.5… |

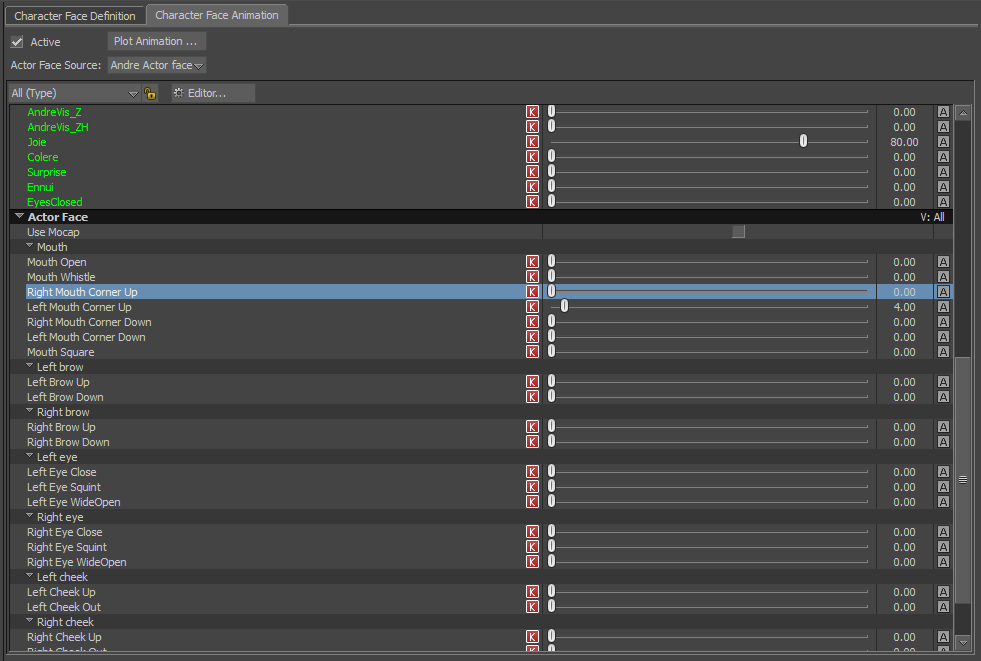

L’interface d’animation du visage, très rudimentaire.

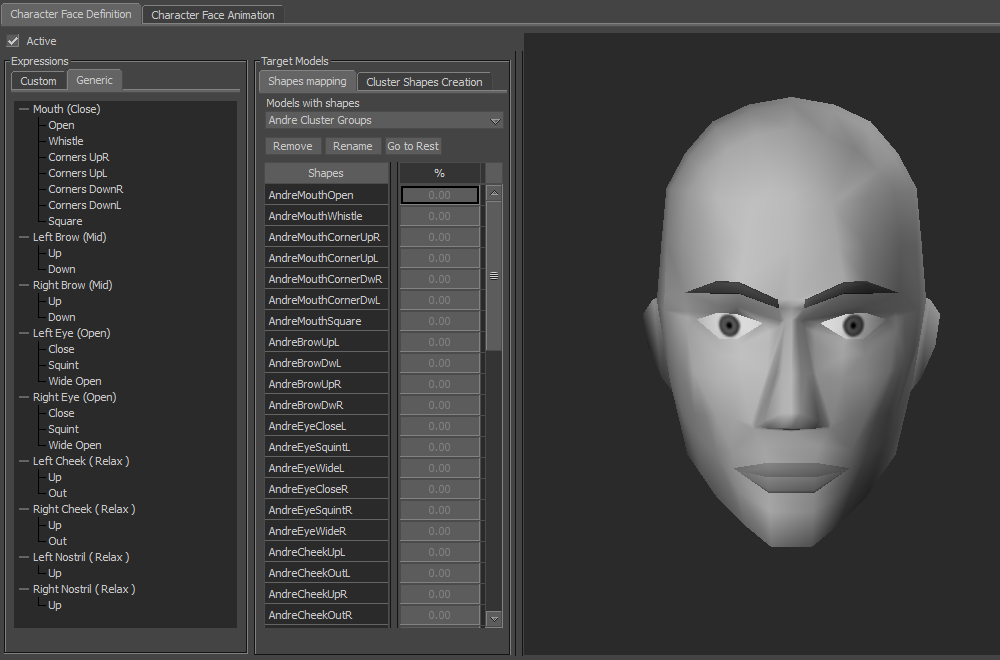

C’est ici que l’on prépare l’outil d’animation faciale.

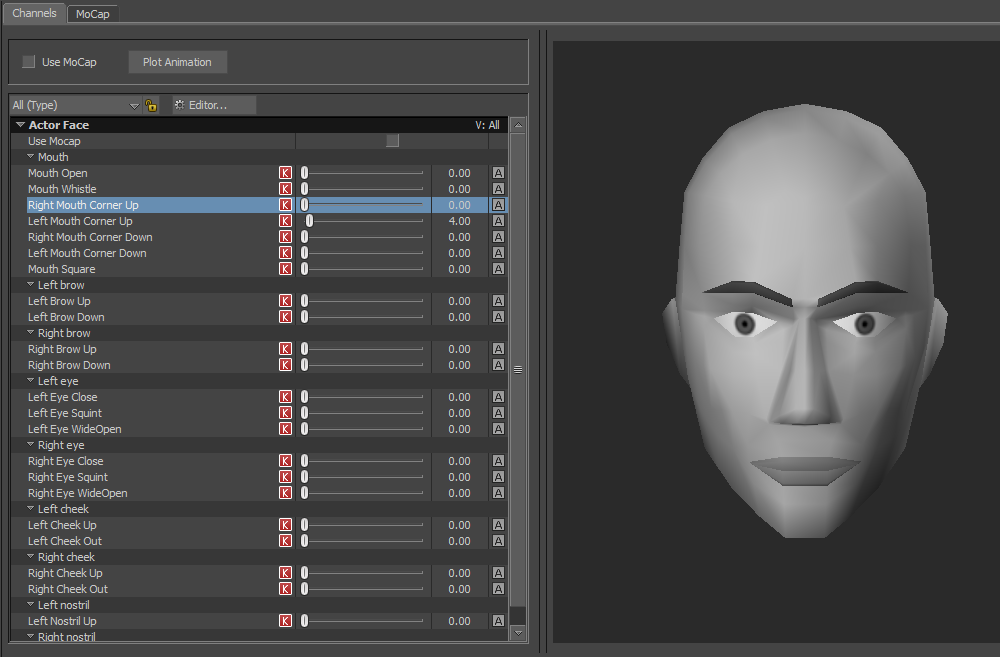

Et voici l’Actor Face, couplé au CharaFace, il permet de gérer la mocap faciale.

Il est tout à faire possible de rigger un visage de façon « conventionnelle ».

| STORY

Autre outil incontournable de l’utilisation de MotionBuilder le Story. |

Cet outil peut gérer des personnages riggés dans Mobu (avec le character control) par le biais de Character Animation Track dans laquelle on définit le personnage qui sera influencé par les clips de la piste.

Mais il est tout à fait possible d’utiliser plusieurs pistes d’animation pour un même personnage en définissant les parties du control rig qui seront gérées par la ou les pistes d’animation. |

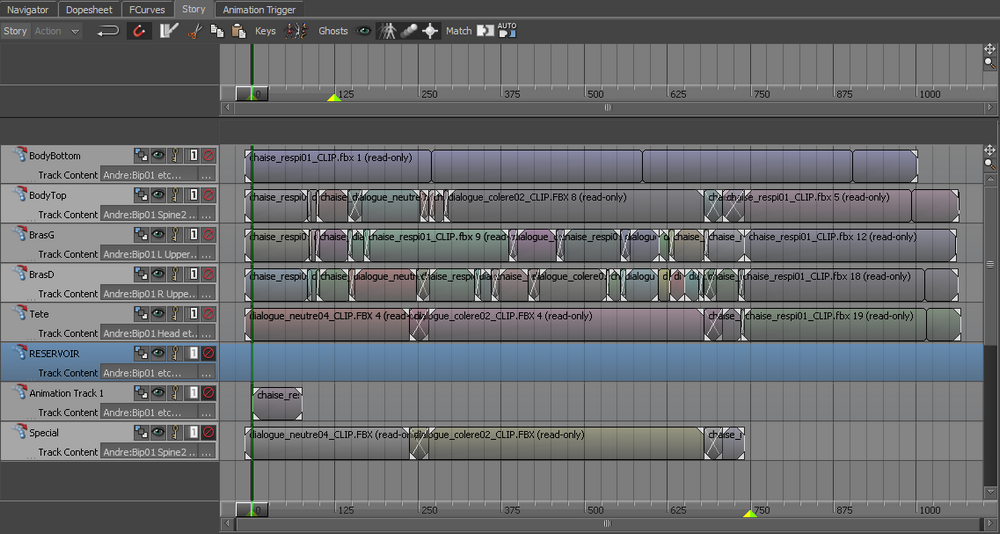

Voici ce que peut donner le story pour un seul personnage.

| Mais ce n’est pas tout, le story peut contrôler n’importe quel type d’objet présent dans une scène au travers d’une Generic Animation track. Dans ce type de piste, on peut inclure n’importe quoi, même un personnage au travers de ses bones. Il suffit d’indiquer les objets ou hiérarchies d’objets à prendre en compte et ils seront contrôlés par la piste du Story.

Le dernier type de piste utilisable dans le story est dédié à la caméra. À l’image des objets de la Généric Track Animation, la Camera Track Animation permet de définir des mouvements types de la caméra. C’est une manière très pratique pour définir un montage des plans de caméra directement dans la scène de travail. |

Généralement, plotter directement dans le squelette définit une animation terminée avec une scène quasi prête à l’export.

Simulation physique Apparue avec l’édition 2011, la physique permet de générer des simulations de manière rapide avec le viewport de MotionBuilder. Tous ces éléments sont paramétrables et l’animation générée par ce biais est récupérable en export. Autre élément lié à cette méthode d’animation, le PhysX qui permet de gérer du cloth, du fluid et du soft body. C’est assez performant et efficace, et ça permet d’avoir une idée de ce qui sera rendu en utilisant ces technologies. |

La physique temps réel de MotionBuilder.

La simulation de tissu en temps réel.

Le ragdoll en action.

| SCRIPT

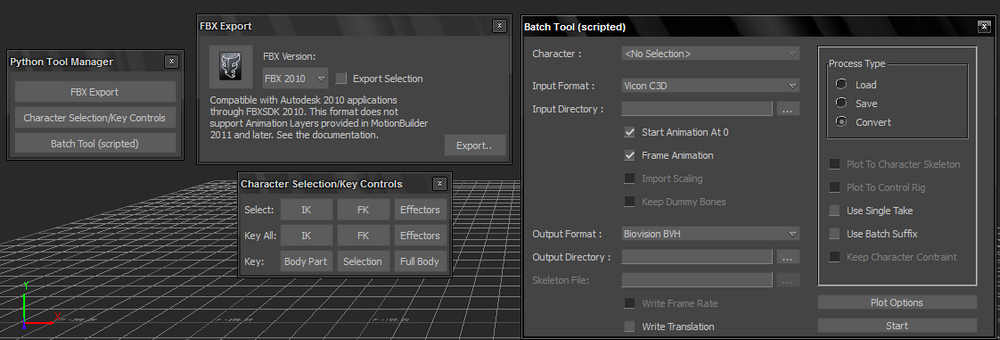

Comme pour la plupart des logiciels 3D, MotionBuilder dispose d’outils de script. – FBX Export : De par le choix de faire du format FBX la plate-forme d’échange entre les logiciels Autodesk, ce format subit beaucoup d’évolution à chaque nouvelle version afin d’inclure toujours plus d’éléments exportable d’un logiciel à l’autre. |

– Character Selection/key Control : Comme son nom l’indique, il permet de sélectionner des Effector en IK ou FK du personnage en cours d’utilisation dans le Character Control et de lui assigner des clés simplement. C’est une autre manière de poser des clés sans avoir le Character Control d’ouvert dans l’interface.

– Batch Tool : Cet outil est assez particulier, il permet de convertir une animation du Character Control en différent format d’animation standard comme le C3D, le BVH ou le FBX. Il est assez complet dans ses options comme on peut le voir sur les captures d’écran. |

Les nouveaux Python tools de base.

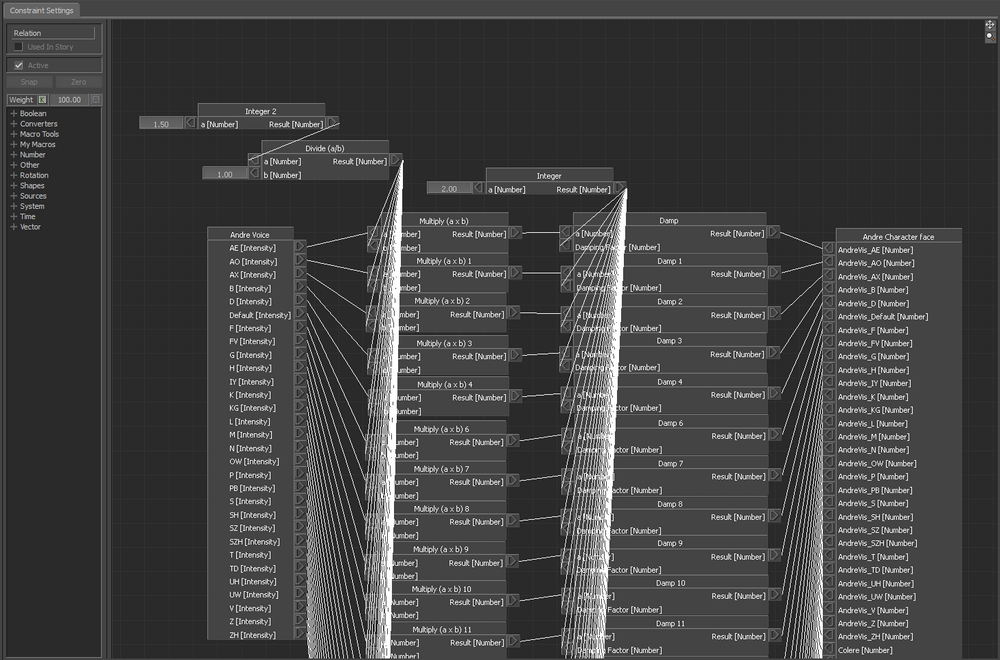

| La façon la plus rapide de scripter des choses dans MotionBuilder est de passer par des contraintes, comme dans la plupart des éditeurs 3D qui font de l’animation. Les contraintes de Mobu sont assez classiques. Il y en a une qui sort pourtant du lot, et elle se nomme Relation. Si vous souhaitez aller plus loin dans les contraintes avec des effets spécifiques comme le contrôle d’éléments de scène par un ou plusieurs périphériques (piste son, clavier, souris, gamepad, glove..), il faudra passer par les Relations. Pour résumer, les relations sont des scripts visuels en nodal. On appelle des fonctions que l’on connecte entre elles. On récupère des valeurs d’entrées générées par des actions dans la scène ou depuis des périphériques, ces valeurs sont modifiées pour ensuite être injectées dans un ou plusieurs éléments de la scène. |

Par exemple, pour faire de la synchronisation labiale, on va utiliser le device Voice afin de détecter les phonèmes vocaux d’une piste son ou d’un micro et injecter les valeurs de ces phonèmes dans les visèmes de l’Actor face au travers du Charactere Face. Voici un exemple simple de ce que cela donne en visuel pour ce qui est de la mise en place en Relation.

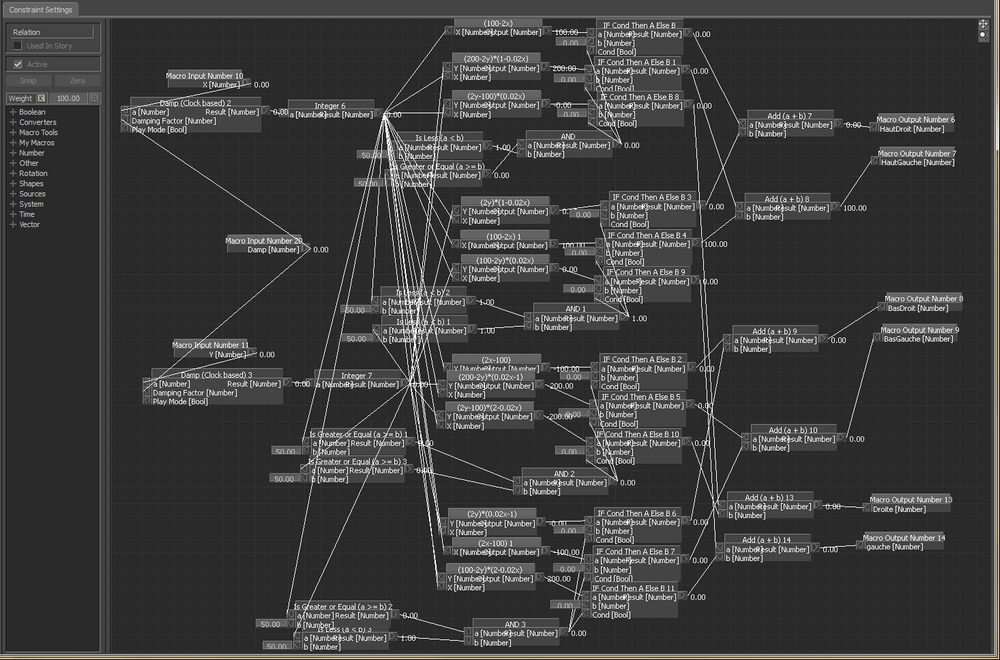

Et il est possible d’aller bien plus loin en utilisant des formules mathématiques plus ou moins complexes pour travailler les données d’entrées. La plupart des fonctions mathématiques qu’on retrouve dans les langages de programmation sont présentes en liste. |

Utilisation d’une relation pour gérer la synchronisation labiale depuis une source sonore (fichier ou entrée live).

Un exemple de relation complexe, celle-ci permet le contrôle du visage par un périphérique, bien plus pratique que l’interface par défaut.