L’image de synthèse 3D dans les dessins animés traditionnels

par Alpe Emmanuel

| « Walt Disney Feature Animation utilise l’animation par ordinateur depuis Basile, Détective Privé au début des années 80. Avec chaque film, Disney continue d’aller de l’avant avec de la technologie de pointe. L’utilisation artistique des ordinateurs a permis à Walt Disney Feature Animation d’améliorer visuellement les films d’animation traditionnels d’une manière qui n’aurait pas été possible de façon conventionnelle. » Ces quelques mots trouvés sur la page web de Disney pour le recrutement d’artistes 3D, montrent bien l’importance de l’image de synthèse dans la production de dessins animés.

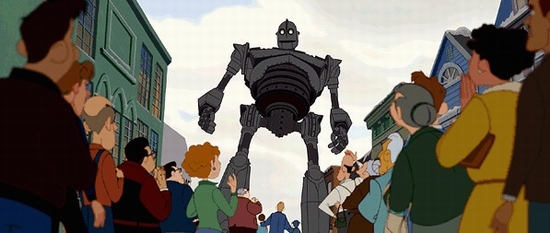

Lors des conférences sur l’animation du salon Imagina 2000, trois dessins animés furent présentés : Tarzan du studio Disney, Iron Giant du studio Warner Bros. et Road to Eldorado du studio Dreamworks. Si les créateurs et le style de ces films (qui sortent à moins d’un an d’intervalle) sont différents, ils ont tout de même un point commun : bien que d’aspect 2D traditionnel, ils font une très large utilisation de l’image de synthèse. Utilisée avec des techniques diverses et dans des situations variées, celle-ci s’impose de plus en plus dans les dessins animés dit « traditionnels » et ce pour plusieurs raisons. En effet, elle offre non seuleument de nouvelles possibilités graphiques, mais permet aussi, dans certains cas, de diminuer les coûts de production et de faire évoluer les techniques de narration dans l’animation. |

Etapes de création traditionnelles

|

Mouvements de caméra complexes, personnages 3D dans des décors 2D ou inversement, interaction entre personnages 2D et 3D, effets spéciaux spectaculaires… tout est possible !

Scénario

Pour tout film, l’écriture du scénario est la première étape. Les dialogues sont en animation moins importants que pour les films live et les scénaristes essayent d’éviter les dialogues longs et complexes. La meilleure animation est celle qui peut se faire comprendre tout en restant muette, les efforts des animateurs se portant sur l’expressivité du corps et du visage des personnages, plutôt que sur l’animation fastidieuse de la bouche en fonction des mots prononcés (technique appelée lipsync, pour lips synchronisation).

Dessin d’un storyboard

Il présente l’action de manière visuelle, un peu comme une bande dessinée. C’est un document qui sera utilisé tout au long de la production et qui permet parfois de détecter des erreurs de structure qui sont moins évidentes dans le scénario. Le nombre d’images varie selon le projet, mais il peut atteindre 100 dessins par minute pour des séquences d’action. Les storyboards de projets d’animation sont généralement plus précis que ceux de films live.

Bande son

Une fois le scénario et le storyboard terminés, l’enregistrement des dialogues et de la musique commence. La bande son sert à l’animateur pour regler le timing de l’action qui doit être parfaitement synchronisé. Normalement, un animateur ne commence pas à dessiner (sauf des tests) avant d’avoir au moins une bande son préliminaire.

Découpage et marquage de la bande son

Lorque la bande son est finie, elle est analysée phonétiquement et cette analyse est reportée sur une fiche de travail nommée « bar sheet ». Les « bar sheets » sont graduées en images (24 pour une seconde en cinéma) et indiquent précisément le début et la durée de tout son, pour que l’animateur puisse animer l’action en conséquence.

Recherche graphique

Pendant le travail sur la bande son, un ou plusieurs artistes travaillent sur la représentation visuelle de tous les personnages et décors du film. Une fois un dessin de personnage approuvé, l’artiste doit faire une fiche modèle qui présente le personnage sous plusieurs angles et avec diverses expressions de son visage. Ces fiches sont parfois accompagnées d’annotations sur les proportions, les habits…

Animatic

Un animatic, aussi appelé « leica reel », est une version vidéo du storyboard, synchronisée avec la bande son. Soit le storyboard est filmé, soit il est redessiné en plus grand, de meilleure qualité et en tenant compte des recherches graphiques approuvées. L’animatic permet d’obtenir une bonne idée du chemin que prend le film puisqu’il montre tous les plans enchainés. C’est pour le réalisateur la dernière occasion de faire des changements sans affecter de manière trop importante le budget et les délais de production.

Tests d’animation

Quand l’animatic est accepté par le réalisateur et le producteur, c’est le début du travail des animateurs. Chaque plan est animé en fonction du timing des « bar sheets ». Les animations sont le plus souvent réussies au premier coup, mais il arrive qu’elles nécessitent plusieurs essais. Petit à petit, les plans terminés vont remplacer les dessins dans l’animatic qui se rapproche de plus en plus du film final.

Mise au propre

Les dessins d’animation ressemblent plus ou moins à des brouillons qui doivent être mis au propre. Cela est généralement fait par une équipe recrutée spécialement pour cela (les « clean-up artists »). Etant donné que plusieurs animateurs travaillent sur les mêmes personnages, cette étape sert aussi à uniformiser les dessins, de manière à ce qu’un personnage ait exactement le même aspect tout au long du film. Les plans mis au propre sont à nouveau testés.

Transfert et coloriage

Les dessins au propre doivent ensuite être transférés sur du celluloid (ou « cel »), les fiches transparentes qui seront finalement filmées. Les dessins sont donc copiés à l’encre ou plus simplement photocopiés sur le cel. Une équipe d’artistes peint ensuite les dessins au verso du cel pour que la peinture reste toujours derrière les lignes.

Création de décors

Pendant le processus d’animation, d’autres artistes peignent les décors, en faisant attention de bien respecter une continuité de style.

|

Vérification

Shoot

Montage et mixage

|

|

Projection

Le film est projeté dans les cinémas sous le regard émerveillé des petits et des grands.

Arrivée de l’informatique et de l’image de synthèse

| La première utilisation de l’outil informatique impliquant les création artistiques, est l’archivage de ces dernières. En effet, avec un simple scanner, il est possible de classer et d’archiver sous forme numérique – et donc inaltérable – tout ce qui doit être conservé. Chez Disney, le DALS (Disney Animation Logistics System) est conçu dans ce but au début des années 80, permettant de relier par liaisons informatiques les quatre studios Disney (Paris, Orlando, Burbank et Simi Valley) qui peuvent ainsi tous accéder à l’ensemble des données.

Au début des années 90, l’informatique fait un pas de plus dans son intégration au processus artistique avec le CAPS (Computer Animation Production System). Ce système co-développé par Pixar obtient un Academy Award de science et technologie en 1992. Il a pour but d’améliorer la productivité (et donc de dinimuer les coûts de production) en traitant de manière complètement numérique l’encrage et le coloriage des dessins. Cela autorise chaque peintre à faire lui-même l’encrage, avec la flexibilité offerte par l’ordinateur. Le CAPS évite donc les problèmes de taches de peinture, d’encre qui bave, d’uniformité des couleurs, de prix des peintures et des encres, de cels abîmés… Ces derniers ne sont plus utilisés et il n’est donc plus besoin de calculer quelle épaisseur de cel il faut utiliser en fonction du nombre de niveaux de profondeur (et donc de cels superposés sur une caméra multiplan) d’un plan. Le CAPS et le DALS fonctionnent donc main dans la main, l’un servant à créer les images et l’autre à les gérer ensuite. Les logiciels de CAPS, d’abord uniquement utilisable sur le matériel propriétaire développé par Pixar est plus tard traduit pour ête utilisable sur les stations de travail Silicon Graphics (SGI). Les autres studios d’animation utilisent le même genre de système, qui peut être issu du commerce ou développé spécifiquement pour leurs besoins propres. Par exemple, pour Le Prince D’Egypte, Dreamworks a utilisé le logiciel Animo de Cambridge Animation Systems pour scanner les dessins, les encrer, les colorier et faire le compositing de tous les niveaux de profondeur.

|

|

Le CAPS est donc la porte d’entrée de l’image de synthèse. Les objets 3D peuvent être intégrés dans l’image par compositing. A partir de ce moment là, il faut trouver un moyen de donner aux objets 3D un aspect 2D, pour qu’il soit impossible (ou du moins difficile) de faire la différence entre les deux.

Le rendu 2D d’objets 3D se compose de deux étapes : le traçage des lignes (« ink ») et le coloriage des surfaces (« paint »). Ces étapes sont généralement gérées par des plug-ins ou des shaders qui offrent à l’utilisateur plus ou moins de réglages possibles. La méthode est propre à chaque logiciel, mais les possibilités sont globalement les mêmes. Prenons l’exemple du Toon shader de Softimage|3D qui peut être utilisé avec le moteur de rendu Mental Ray et qui a déjà fait ses preuves, par exemple dans le dernier film de Hayao Miyasaki, Princesse Mononoké et dans Le Prince d’Egypte. Il se compose en fait de deux shaders différents, un pour chaque étape. L’encrage est pris en charge par un shader de type « Lens » qui est en fait un shader appliqué à la caméra et que l’on sélectionne dans les propriétés de rendu. Le coloriage, quant à lui, est pris en charge par un shader de type « material » qui s’applique aux objets. Softimage propose aussi un plug-in nommé Toon Assistant qui permet d’appliquer les paramètres de rendu 2D à la scène entière, mais avec moins de précision dans les contrôles.

| Pour ce qui est du traçage des lignes, la principale dificulté est d’arriver à obtenir des lignes uniquement là où l’on en veut. Le shader crée des lignes sur les contours des objets mais aussi sur le contour d’éventuels trous, aux intersections de surfaces et là où il y a discontinuité dans la courbure d’une surface. De plus une option permet de faire apparaître des lignes entre deux couleurs de remplissage. Une autre option intéressante offre la possibilité de faire paraître un groupe d’objets comme un seul modèle, en demandant au Toon Material shader de ne pas tracer de ligne aux intersections de plusieurs objets. Ces objets doivent évidemment avoir le même material pour que l’illusion fonctionne. Elle est cependant limitée puisque, lors de l’animation, la distinction entre les objets risque de devenir visible à cause de l’action de la lumière et des discontinuités qui peuvent se créer dans la surface du modèle. Il y a ensuite plusieurs paramètres pour modifier l’aspect des lignes, de manière à donner plus de caractère aux images finales. Tout d’abord, il est possible de régler, avec un simple bouton de type slider, l’épaisseur des lignes. Vient ensuite le choix de la couleur des lignes. Soit on choisit une couleur de manière arbitraire, soit on utilise la couleur « ambient » du material assigné à l’objet. Pour finir, il existe deux options : l’une permet de rendre les lignes de contour plus ou moins saturées et plus ou moins claires, et l’autre permet d’assombrir automatiquement celles qui se trouvent dans des zones d’ombre. Une fois que la couleur et l’épaisseur générales des lignes sont déterminées, il est encore possible de leur donner un style particulier. Les paramètres proposés influent sur l’épaisseur et la couleur des lignes en simulant le fait qu’un dessin est constitué de plusieurs coups de crayon ou de pinceau. Pour l’épaisseur, on peut choisir la fréquence et l’importance des variations et pour la couleur, la fréquence et le type (teinte, saturation ou luminance). A noter que comme toujours dans Softimage|3D, ces réglages sont tous animables, soit en choisissant une valeur d’animation automatique, soit en enregistrant des clés d’animation ! |  |

Le coloriage des surfaces dispose de moins de réglages. Les surfaces sont rendues avec comme couleur principale la couleur « ambient » du material. La couleur de « hilight » (endroit où la lumière produit une brillance) est un produit de la couleur « specular » du material et de la couleur de la lumière. D’autre part deux lumières qui éclairent un même objet créent deux couleurs de « hilight » qui se combinent de manière additive. La couleur d’ombre est celle choisie en « diffuse » pour le material (à noter que c’est la couleur la plus sombre qui peut être attribuée à la surface, il est donc conseillé qu’elle soit très foncée dans le cas d’une ambiance sombre). Dans le logiciel Lightwave, le Super Cel Shader propose quatre couleurs, avec ou sans influence de la coloration de la lumière.

|

Intégration et interaction 2D/3D : Lorsque l’image rendue doit être intégrée à une image dessinée, le tout doit former une image finale cohérente. Dans ce but, il y a diverses précautions à prendre. Globalement, les images générées par ordinateur ont tendence à être trop « parfaite ». C’est à dire, par exemple, que les courbes peuvent être parfaitement circulaires et les lignes parfaitment droites, ce qui n’est jamais le cas dans un dessin. Dans le film Iron Giant (excellente réussite de mélange 2D/3D), le géant a été animé avec le logiciel Maya et les créateurs ont développé un programme spécialement pour altérer les lignes parfaites du géant. Ils ont étudié les dessins d’un artiste qui faisait la mise au propre de l’animation d’un personnage et fait en sorte que leur programme génère des lignes du même genre. Ils ont même poussé dans le détail jusqu’à donner au géant la texture particulière due au grain du papier utilisé pour les dessins ! |

|

|

Lors de la modélisation, il est judicieux de construire les objets à l’aide de surfaces patch ou NURBS. En effet celles-ci sont plus adaptées à la création de modèles arrondis qui se mélangeront mieux avec les dessins tout en courbes de l’animation traditionnelle. Lors du rendu des images 3D, il faudra s’assurer d’utiliser l’antialiasing de manière appropriée. Les lignes doivent avoir le même aspect que celles des dessins, et si l’antialiasing n’est pas suffisant, elles risquent de donner une impression de clignotement ou de scintillement quand les objets seront animés. L’animation par ordinateur, elle aussi, doit être du même style que l’animation traditionnelle. Cela implique que l’on ne devra calculer qu’une image sur deux la plupart du temps, quand l’animation traditionnelle n’utilise que 12 dessins par seconde. En effet, seules les séquences d’action avec des mouvements très rapides requièrent 24 dessins différents par seconde. D’autre part l’animation traditionnelle est en général très « snappy » (péchue, claquante), ce qui devra être reproduit en animation 3D en éditant en conséquence les courbes d’animation. Enfin, deux derniers points sont à vérifier pour une image parfaitement cohérente. Premièrement, l’éclairage. Le spectateur doit avoir l’illusion que les objets 3D et les dessins sont éclairés par les mêmes sources lumineuses.

| Cela doit donc faire l’objet d’une réflexion avant le coloriage des dessins. Deuxièmement, les effets de la perspective doivent s’appliquer de la même manière aux éléments 2D et aux éléments 3D. En 2D, si un personnage s’approche du point de vue, il est dessiné de plus en plus gros. En 3D, par contre, il est simplement déplacé en direction de la caméra, et l’effet de grossissement dépend des réglages de l’objectif simulé par la caméra virtuelle. Il faut donc paramétrer la caméra de manière à ce que le personnage 3D grossisse à la même vitesse que celui en 2D. |  |

|

La difficulté est ensuite de faire interagir des éléments 2D avec des éléments 3D. Dans ce domaine, le cas le plus complexe est probablement celui de l’interaction entre deux personnages. C’est un problème auquel l’équipe de Warner Bros a dû faire face tout au long de la réalisation de Iron Giant puisque les deux personnages principaux sont le géant en 3D et un petit garçon en 2D du nom de Hogarth. Chacun doit donc réagir en fonction des actions de l’autre. De manière générale, les actions du géant influençaient celles de Hogarth plus que le contraire et c’est donc le géant qui était animé en premier. Un rendu rapide de basse qualité était ensuite généré pour que l’animateur de Hogarth puisse synchroniser son animation à celle du géant. Parfois, c’est Hogarth qui « menait » l’action et il était donc animé en premier. Par exemple, si il se déplace et que le géant le suit du regard, l’animateur 3D charge l’animation du garçon dans l’ordinateur avant de commencer l’animation du robot. Quand une séquence comprenait beaucoup d’interactions et de réactions, il devenait complexe de faire des allers et retours incessants entre animation 2D et animation 3D. Dans ce cas, l’animation était confiée à un animateur qui savait utiliser aussi bien les crayons que l’ordinateur et pouvait ainsi s’occuper des deux personnages. Ces allers et retours entre 2D et 3D ou entre techniciens et artistes sont un des challenges que présente le mélange des techniques d’animation. On a vu, dans les films déjà cités, des personnages en 2D qui utilisent des objets en 3D (par exemple, à la fin du Prince D’Egypte, Moïse porte les fameuses tablettes de pierre gravées : elles ont été créées en 3D) ou qui sont transportés par des véhicules 3D (les voitures de Iron Giant). Les méthodes sont désormais parfaitement au point, et les réalisateurs savent qu’ils doivent planifier précisément ce genre de plan, et faire coopérer efficacement les animateurs 2D avec les animateurs 3D et les techniciens avec les artistes.