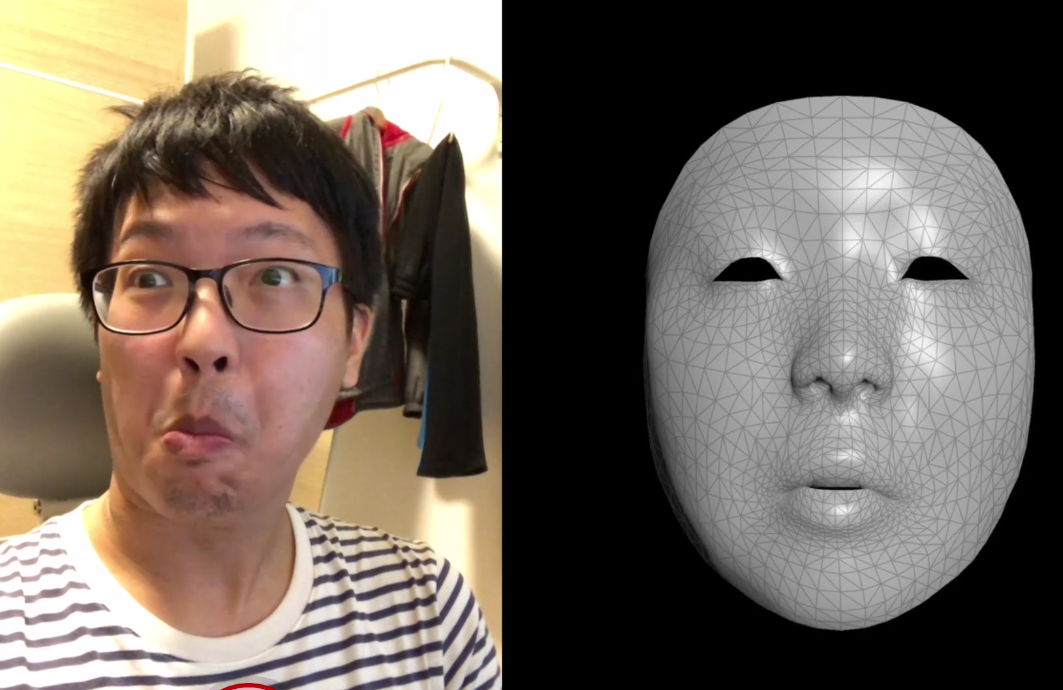

Elisha Hung présente une expérimentation réalisée à l’aide des données de la caméra TrueDepth de l’iPhone X. Cette dernière, située en haut de l’écran du nouveau smartphone d’Apple, comporte un système qui projette des points pour établir une carte de profondeur du visage de l’utilisateur : un procédé similaire à celui de la défunte Kinect de Microsoft.

Si le système est surtout utile en biométrie, il peut aussi être détourné. Elisha Hung s’est appuyé sur ARKit pour extraire les données, puis les envoyer sous Houdini.

Dans celui-ci, un SOP (Surface OPerator) Python permet d’importer les données et de s’en servir pour l’animation.

Le résultat est loin d’être parfait : les expressions sont très clairement atténuées et imprécises, en particulier lorsqu’Elisha Hung prend des poses extrêmes. Pour des poses plus naturelles, en revanche, le résultat est intéressant.

Les commentaires des deux vidéos donnent plus de détails techniques ; un article a également été publié, en chinois ; Google Traduction vous donnera une idée approximative de son contenu.

Les sources sont proposées sur GitHub.

iPhone X Face Motion Capture into Houdini from Elisha Hung on Vimeo.

iPhone X Face Motion Capture into Houdini (Projection mapping) from Elisha Hung on Vimeo.